Entre fĂŠvrier et mars 2013, jâai eu lâoccasion de visiter deux laboratoires de recherche Bell Labs dâAlcatel-Lucent en France : celui de Villarceaux et celui de Marcoussis. Ils mâont permis Ă la fois de voir comment fonctionnaient certaines ĂŠquipes de recherche et leurs liens avec le monde extĂŠrieur, mais surtout de dĂŠcouvrir les technologies gĂŠnĂŠralement inconnues du grand public et qui permettent Ă lâInternet dâabsorber des volumes de donnĂŠes sans cesse grandissant.

Les analystes et fournisseurs comme Cisco nâont en effet de cesse de nous rappeler le poids grandissant de la vidĂŠo dans le trafic Internet, quâil sâagisse de VOD, de SVOD, de TV de rattrapage et bien ĂŠvidemment de la consommation de contenus sur YouTube, DailyMotion et leurs ĂŠquivalents. On nous prĂŠdit aussi dâannĂŠe en annĂŠe la saturation dâInternet, qui ne serait plus capable dâabsorber les dĂŠbits associĂŠs. En France, les chaines de TV sont ĂŠgalement inquiètes au sujet de la capacitĂŠ des rĂŠseaux Ă absorber ne serait-ce que la TV de rattrapage, de plus en plus populaire.

Cette visite dâAlcatel-Lucent permet dâĂŠclairer notre lanterne sur quelques questions clĂŠs : quels sont les dĂŠbits actuels supportĂŠs par les rĂŠseaux Internet, quel est le besoin pour absorber la croissance du trafic due notamment Ă la consommation de vidĂŠo, et est-ce que les progrès technologiques anticipables permettront dâabsorber cette croissance ?

Alcatel-Lucent est particulièrement en pointe sur deux technologies clĂŠs : les systèmes de transport Ă base de fibres optiques et les composants ĂŠlectroniques et optroniques très spĂŠcialisĂŠs que lâon y trouve et quâil fabrique lui-mĂŞme en petites quantitĂŠs. MalgrĂŠ tout, Alcatel-Lucent se dĂŠfinit comme ĂŠtant plutĂ´t un intĂŠgrateur. Il conçoit une part des technologies critiques de ses produits ce qui lui permet de se diffĂŠrentier par rapport Ă la concurrence. Celle-ci est toutefois très active, notamment chez le chinois Huawei, qui dispose de ressources ĂŠnormes dans la R&D. La bataille de lâinnovation dans ce secteur sâarticule comme dans de nombreuses industries autour dâune part dâune R&D de qualitĂŠ et de lâautre dans la capacitĂŠ Ă en industrialiser rapidement les rĂŠsultats pour crĂŠer des produits ayant le bon âtime to marketâ et aussi Ă un prix compĂŠtitif.

La fractale des rĂŠseaux IP

Depuis la fin des annĂŠes 1980, le dĂŠbit des rĂŠseaux de tĂŠlĂŠcommunication et celui dâInternet (après 1993) dĂŠpend ĂŠtroitement des technologies de transport Ă base de fibres optiques. Elles seules sont capables de transporter de gros volumes de donnĂŠes et sur de longues distances.

Dans les routes de lâInternet, il faut distinguer :

- Les autoroutes qui sont les liaisons longue distance reliant les continents entre eux via des câbles sous-marins comprenant en gĂŠnĂŠral huit paires de fibres optiques. Ils se poursuivent sur terre dans des câbles enterrĂŠs qui relient les grandes agglomĂŠrations. Ces rĂŠseaux relient les opĂŠrateurs tĂŠlĂŠcoms entre eux Ă lâĂŠchelle mondiale. Aux USA, ce sont les RBOC (Regional Bell Operating Companies) issues du dĂŠmantèlement dâAT&T en 1982) qui relient le pays au reste du monde, et ĂŠvidemment via les cĂ´tes Ouest et Est des USA. Les dĂŠbits de ces autoroutes peut ĂŞtre de plusieurs Tera-bits/s pour les liaisons les plus rĂŠcentes.

- Les nationales, avec, dans chaque pays, les liaisons et infrastructures de communication des opĂŠrateurs tĂŠlĂŠcoms, aussi Ă base de fibres optiques. Elles relient entre eux les centraux tĂŠlĂŠcoms des opĂŠrateurs, notamment dans les centraux de France TĂŠlĂŠcom qui hĂŠbergent les NRA (NĹuds de Raccordements dâAbonnĂŠs) et les NRO (NĹuds de Raccordements Optiques). Câest lĂ quâaboutissent dâun cĂ´tĂŠ les rĂŠseaux IP internes des opĂŠrateurs et de lâautre les terminaisons des utilisateurs. Les nationales sont bien moins rapides que les autoroutes en France : les liaisons se font avec des tuyaux qui dĂŠmarrent Ă 10 Gbits/s et peuvent aller jusquâĂ plusieurs Tera-bits selon lâimportance des nĹuds de rĂŠseaux des opĂŠrateurs.

- Les ĂŠchangeurs, avec lâinterconnexion entre opĂŠrateurs, reliĂŠs entre eux pour assurer leur interopĂŠrabilitĂŠ et un bon ĂŠcoulement du trafic. On appelle cela le âpeeringâ ou appairage. Il existe une vingtaine dâacteurs du peering en France, ĂŠtablis souvent en associations comme France IX ou SFINX qui est un service opĂŠrĂŠ par le rĂŠseau universitaire Renater. Les gros opĂŠrateurs tĂŠlĂŠcoms ont des points de peering Ă Paris et dans quelques grandes villes de France comme Lyon et Marseille. Les dĂŠbits du peering varient de 1 Ă plusieurs centaines de Gbits/s.

- Les dĂŠpartementales, avec des infrastructures dĂŠportĂŠes sur le terrain des centraux tĂŠlĂŠcoms, comme des rĂŠpartiteurs et autres DSLAM. En ville, un DSLAM typique pour lâADSL va ĂŞtre connectĂŠ dâun cĂ´tĂŠ Ă 1008 abonnĂŠs et de lâautre par une liaison de 10 Gbits/s au rĂŠseau. Ce qui donne un dĂŠbit moyen disponible de 10 Mbits/s par abonnĂŠ ce qui est thĂŠoriquement bien dimensionnĂŠ pour que tout les foyers connectĂŠs puissent regarder un flux TV HD non-linĂŠaire par foyer (6 Mbits/s) en mĂŞme temps.

- Les rues, avec les terminaisons de boucle locale qui aboutissent dans les immeubles, maisons et entreprises. Les entreprises louent parfois des âfibres noiresâ pour relier entre eux plusieurs sites, mais sans passer par le rĂŠseau ouvert de lâInternet. Elles ont donc leur ârueâ privatisĂŠe. Ces boucles locales sont en paire de cuivre torsadĂŠe (la ligne de tĂŠlĂŠphone classique, pour la voix analogique et lâADSL) ou en fibre (pour le FTTH, la fibre qui va jusquâaux abonnĂŠs). Il y a aussi le coaxial en cuivre du câble mais qui ne passe gĂŠnĂŠralement pas par les infrastructures de France TĂŠlĂŠcom. Le câble est aussi reliĂŠ Ă de la fibre dans les infrastructures des câblo-opĂŠrateurs.

- Les stations service, pour poursuivre lâanalogie routière, que sont les CDN, Content Delivery Network, qui bufferisent les contenus lourds comme les vidĂŠos pour en accĂŠlĂŠrer lâaccès aux consommateurs. Ils sont tĂŠlĂŠchargĂŠs une fois pour toute sur des serveurs proches des consommateurs Ă lâĂŠchelle rĂŠgionale voire dĂŠpartementale pour ce qui est de la France. Cela limite le trafic sur les nationales et les autoroutes.

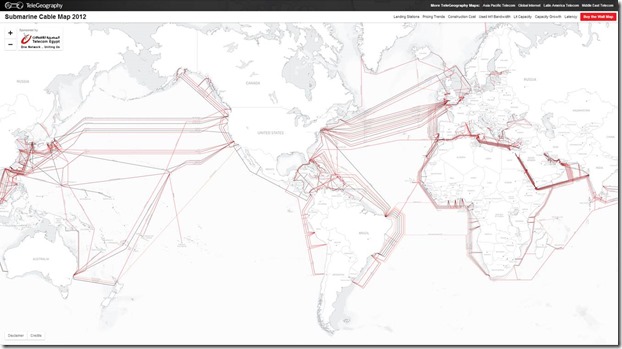

Les câbles sous-marins

Ce sont les plus grosses artères de lâInternet. Les câbles sous-marins font transiter le dĂŠbit Internet entre continents et pays. Il est colossal mĂŞme si une bonne part du trafic est local dans chaque pays. Au quotidien, nous utilisons souvent des services en ligne hĂŠbergĂŠs Ă lâĂŠtranger. De France, les points dâaccès les plus proches de Google Search ou YouTube sont ainsi en Irlande ou en Belgique. Autre exemple, les serveurs 1&1 de ce blog sont en Allemagne et on transite par la Hollande pour y parvenir.

Il y a environ un millier de points de dĂŠparts et dâarrivĂŠe de câbles sous-marins dans le monde. Ils sont inventoriĂŠs ici. En France, nous avons notamment Ajaccio et lâIle Rousse en Corse, Basse-Terre et Pointe Ă Pitre en Guadeloupe, Saint BarthĂŠlĂŠmy et la Guyane. En mĂŠtropole, nous avons Penmarch et Lannion en Bretagne, Cayeux sur Mer, Saint Valery en Caux et Dieppe en Normandie, Dunkerque et Sangate dans le Nord et Cannes, Marseille et Martigues dans le Sud-Est. En tout, ce sont plusieurs TĂŠra-bits/s qui nous relient aux autres pays.

Les câbles sont posĂŠs en mer par des navires câbliers. Il y en a environ 35 dans le monde dont 4 dâAlcatel-Lucent et 4 de France TĂŠlĂŠcom Marine (des rumeurs courent depuis quelques temps sur le rachat de lâactivitĂŠ dâAlcatel-Lucent par France TĂŠlĂŠcom). Ils sont complĂŠtĂŠs par des navire spĂŠcialisĂŠs dans la rĂŠparation des câbles – qui sont 3 pour Alcatel-Lucent (ci-dessus le Lodbrog) – mais certains sont Ă la fois adaptĂŠs Ă la pose et Ă la rĂŠparation des câbles. Les trois principaux câbliers dâAlcatel-Lucent sont Ile de Brehat, Ile de Sein et Ile de Batz. Ils font 140 m de long, 23 m de large et 8 m de tirant dâeau. Construits en 2002, ils contiennent deux cuves de 1500 m3 de câbles.

Les câbliers utilisent un système tractĂŠ de 25 tonnes et 10,4 m de long pour lâenterrement des câbles sur fonds marins Ă 3m en dessous du fond de la mer (ci-dessous, photo Alcatel-Lucent). Ces systèmes dâenfouissement fonctionnent jusquâĂ 1500m de profondeur. En dessous, les câbles sont simplement posĂŠs sur le fond de la mer, jusquâĂ 8000m de profondeur ce qui permet de bien couvrir la plupart des routes sauf les fosses les plus profondes comme celles des Mariannes.

Lâenterrement des câbles rĂŠduit dâun facteur 12 les dĂŠgâts non naturels provoquĂŠs notamment par les chaluts de pĂŞcheurs. Dans les navires câblier, les cales de stockage font 7 m de haut et 19 m de diamètre et peuvent chacune contenir environ 3 000 km de câble, donc 6000 Km au total, ce qui permet de couvrir une bonne partie des routes sans revenir au port. Ce dâautant plus que faire le plein des câbliers est un travail très minutieux. Câest un test de patience pour les ouvriers puisquâil dure environ un mois ! Les câbliers font ĂŠvidemment le plein Ă proximitĂŠ des usines de fabrication de câbles, sur les cĂ´tes comme dans celle de Calais. La cadence de chargement est de 14 km de câble par heure, qui soigneusement enroulĂŠ (voir cette vidĂŠo)

Pour les longues distances, les câbles posÊs sont dotÊs de rÊpÊteurs tous les 40 à 100 km selon la technologie utilisÊe. Pour les courtes distances et les trajets le long des côtes comme en Afrique, les câbles peuvent ne pas avoir de rÊpÊteurs.

Les rĂŠpĂŠteurs fonctionnent Ă base dâamplificateurs optiques alimentĂŠs par un courant ĂŠlectrique qui parcourt tout le câble sous-marin. Ces amplificateurs sont Ă base de lasers utilisant des fibres en verre dopĂŠes Ă lâErbium. Un câble sous-marin moderne est dotĂŠ de huit paires de fibres. Les fibres sont en effet unidirectionnelles.

Comment rĂŠpare-t-on les câbles ? Tout dâabord, il faut dĂŠtecter oĂš se situe la coupure ou lâusure. Cela se fait Ă terre avec des outils de mesure ĂŠlectrique qui utilisent la technique du SSTDR, pour âspread-spectrum time-domain reflectometryâ. En gros, cela consiste Ă envoyer un signal optique dans un sens et Ă mesurer celui revient et Ă calculer sa distance en fonction du temps dâaller et retour. Ensuite, on envoie un navire de rĂŠparation qui va rĂŠcupĂŠrer le câble en le coupant Ă lâendroit approximatif de la panne. Les deux extrĂŠmitĂŠs sont sorties de lâeau et on les relie par un bout de câble de plusieurs centaines de mètres de long avec un système dâĂŠpissure adaptĂŠ aux fibres optiques. Puis on rebalance le tout en mer avec ou sans enterrement selon la profondeur.

Les leaders de la pose de câbles sous-marins sont lâamĂŠricain Tyco, le japonais NEC et Alcatel-Lucent. Mais en plus de France TĂŠlĂŠcom, une vingtaine de sociĂŠtĂŠs sont prĂŠsentes sur ce marchĂŠ, dont Mitsubishi, Ericsson, Nokia, Hitachi, Siemens, Pirelli et Nexans.

Ces câbles sous-marins aboutissent Ă terre dans des salles techniques qui font jusquâĂ 2000 m2. Elles sont dotĂŠes de tous les ĂŠquipements ĂŠlectroniques et optroniques pour dĂŠmultiplexer les signaux numĂŠriques transmis et les envoyer dans les rĂŠseaux terrestres et les ânationalesâ.

Comment augmente-t-on le dĂŠbit sur la fibre optique ?

Quand on sait que les processeurs en technologie silicium CMOS les plus rapides ne dĂŠpassent pas 4 GHz, on peut se demander comment on arriver Ă gĂŠrer des bandes passantes de plusieurs TĂŠra-bits/s dans les fibres optiques.

Cela repose sur deux composantes technologiques clĂŠs quâAlcatel-Lucent maitrise particulièrement bien :

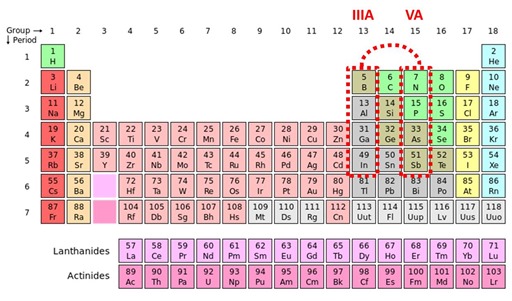

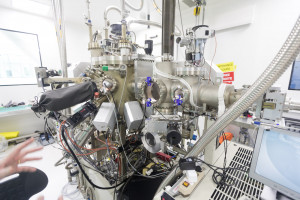

Dâun cĂ´tĂŠ, des composants ĂŠlectroniques utilisant des semi-conducteurs dits III-V, qui combinent des ĂŠlĂŠments des groupes 13 et 15 du tableau des ĂŠlĂŠments de MendeleĂŻev (en pointillĂŠ rouge ci-dessous), correspondant aux groupes III-A et V-A dans lâancienne numĂŠrotation romaine du tableau pĂŠriodique des ĂŠlĂŠments. On y trouve notamment lâaluminium, le Gallium, le Phosphore et lâArsenic qui se combinent par paire III+V avec par exemple de lâarsĂŠniure de gallium. Ces composants prĂŠsentent la caractĂŠristique de pouvoir tourner Ă très haute frĂŠquence, jusquâĂ environ 50 GHz. Nous y reviendrons plus tard. Ces composants servent Ă gĂŠnĂŠrer le signal ĂŠlectrique avec des 0 et des 1 qui sera ensuite converti avec des diodes laser en lumière Ă faire transiter par les fibres. Mais on ne peut pas aller au-delĂ de 40 GBits/s avec cette technologie. Le laboratoire de Marcoussis dâAlcatel-Lucent qui est commun avec Thalès et le CEA-LETI est dĂŠdiĂŠ Ă la recherche et Ă la fabrication en petites quantitĂŠs de semi-conducteurs pour ces applications dâoptronique permettant de gĂŠrer des dĂŠbits ĂŠnormes dans les fibres optiques.

De lâautre, nous avons des techniques de multiplexage consistant Ă faire passer plusieurs ondes lumineuses distinctes dans la mĂŞme fibre optique. Ce sont des voies (lanes) de donnĂŠes indĂŠpendantes des autres dans les fibres optiques. En sâalignant sur une frĂŠquence gĂŠrable par ĂŠlectronique (genre 25 GHz), on envoie plusieurs bits en simultanĂŠ sur une mĂŞme fibre optique avec plusieurs types de multiplexage qui sont exploitĂŠs simultanĂŠment :

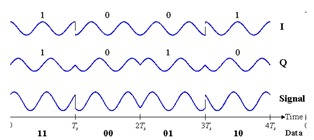

- De la polarisation de la lumière avec deux polarisations, une verticale et une horizontale, qui double le dĂŠbit. Cette technique prend lâappellation de DP pour âDual Polarizationâ.

- De la modulation de phase, qui permet aussi de doubler la capacitĂŠ. En gros, on dĂŠcale ou pas un signal dâune demi longueur dâonde pour les bits de deux flux. On double ainsi la capacitĂŠ avec cette technique dite QPSK pour âquadrature-phase-shift keyingâ. CombinĂŠe Ă de la polarisation, cela donne le DP-QPSK.

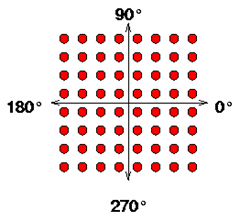

- De la modulation dâamplitude multi-niveaux de la lumière, qui permet de doubler voire de quadrupler la capacitĂŠ. Elle est combinĂŠe Ă la modulation de phase. On appelle cela le QAM pour âquadrature amplitude modulationâ. Une modulation QAM64 combine quatre niveaux de luminositĂŠ et deux phases. On reprĂŠsente alors les 64 combinaisons de 4 bits dans le diagramme suivant en nombre complexe (le X et le Y reprĂŠsentent deux phases dĂŠcalĂŠes dâune demi-longueur dâonde). A noter que le QAM est aussi utilisĂŠ dans lâencodage dâondes ĂŠlectromagnĂŠtiques, comme dans le Wi-Fi, dans la 3G et la 4G. Dans le spectre-ĂŠlectromagnĂŠtique, on peut aller jusquâĂ du QAM256, comme dans le câble coaxial, encodant ainsi 8 bits sur un Hertz au lieu de 4 dans le cas de la fibre optique.

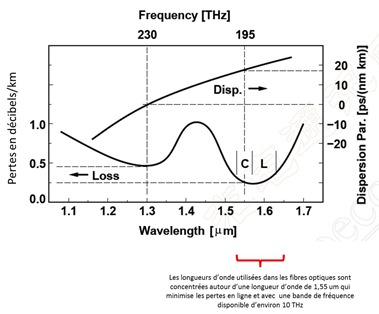

- Enfin, lâusage de plusieurs longueurs dâondes diffĂŠrentes avec le WDM (Wavelenght Division Multiplexing). Les liaisons longue distance sâappuient sur une longueur dâonde autour de 1,55 microns avec une largeur de spectre disponible dâenviron 10 THz. La bande de frĂŠquences autour de 1,55 ¾m est dĂŠnommĂŠ “bande C”. Câest celle qui gĂŠnère le moins dâattĂŠnuation sur la distance. Elle est dâenviron 0,2 dB par kilomètre. Câest ce qui fait la diffĂŠrence avec la transmission sur cuivre qui gĂŠnère une attĂŠnuation de plus de 10 db par km dans le cas de lâADSL ! A raison de 25 GHz par canal, cela donne une capacitĂŠ thĂŠorique maximale de 400 ondes par fibre. Mais il faut laisser une marge de sĂŠcuritĂŠ pour ĂŠviter les effets de bord entre chaque bande de frĂŠquence. En pratique, on peut faire passer jusquâĂ deux cent longueurs dâondes diffĂŠrentes dans une fibre optique. Câest une technique très puissante mais couteuse car elle nĂŠcessite beaucoup de filtres en amont et en aval de la fibre.

Vers quel dĂŠbit maximum ?

Si on cumule toutes les techniques de multiplexage, on peut ainsi obtenir un coefficient multiplicateur de dĂŠbit de 2x2x4x200 = 3200. AppliquĂŠ Ă un dĂŠbit de base de 25 Gbits/s, cela donne une capacitĂŠ thĂŠorique maximale dâenviron 80 Tbits/s pour une fibre mono-cĹur. Mais cette capacitĂŠ thĂŠorique est atteignable sur des distances moyennes de quelques dizaines de kilomètres. Plus on allonge la distance, notamment au niveau de celle des câbles sous-marins, plus il est difficile de gĂŠrer ces ultra-haut dĂŠbits.

Avec 8 paires de fibres mono-cĹur dans les câbles sous-marins ou terrestres, on obtient en tout cas une capacitĂŠ thĂŠorique maximale de 640 Tera-bits/s par câble. Une capacitĂŠ voisine, de 1000 tera-bits/s, a ĂŠtĂŠ expĂŠrimentĂŠe fin 2012 par le japonais NEC avec une fibre Ă douze cĹurs et sur une distance de 52 km. Chaque cĹur transportait 84,5 Tbits/s avec 380 Gbits/s sur 222 longueurs dâondes diffĂŠrentes. De son cĂ´tĂŠ, Alcatel-Lucent travaille sur une technologie voisine, atteignant 400 Gbits/s par longueur dâonde mais capable de fonctionner sur de plus grandes distances, de plusieurs centaines de km. Mais les roadmaps technologiques des constructeurs laissent penser que lâon pourra aller encore plus loin.

Tout cela semble fournir une belle marge de progression par rapport aux câbles actuels qui supportent entre 1 et une quinzaine de TÊra-bits/s.

La marge de manĹuvre technologique semble assez confortable, sur la papier, pour faire grandir le dĂŠbit de lâInternet et supporter notamment lâaugmentation de la consommation de vidĂŠos non-linĂŠaires. Il subsiste cependant une variable non technique primordiale : le dimensionnement ĂŠconomique de ces solutions. Les techniques de multiplexage sont couteuses sans compter les techniques de routage qui vont avec pour dispatcher les signaux de ces fibres dans les rĂŠseaux. Et lâaugmentation des coĂťts demande des modèles ĂŠconomiques qui tiennent le coup aussi bien pour les opĂŠrateurs tĂŠlĂŠcoms que pour les autres maillons de la chaine de valeur de la diffusion des contenus vidĂŠo.

Lâimpact sur la tĂŠlĂŠvision numĂŠrique via Internet

Faisons un petit calcul simple. Supposons que 22 millions dâabonnĂŠs Ă lâADSL consomment en simultanĂŠ des flux vidĂŠo HD de 6 Mbits/s non linĂŠaires (tous diffĂŠrents, donc pas optimisĂŠs avec du multicast) provenant de la mĂŞme origine, genre un data-center en Irlande pour un Google TV ou un Apple TV. Cela reprĂŠsenterait un dĂŠbit total de 132 Tbits/s. Mettons-nous maintenant dans dix ans dans la perspective dâun usage gĂŠnĂŠralisĂŠ de la vidĂŠo UHD (Ultra-HD, ou 4K, avec le quadruple de la rĂŠsolution du Full HD), couplĂŠ Ă lâusage du codec HEVC. Cela donnerait un dĂŠbit dâenviron 24 Mbits/s et ne fonctionnerait bien quâavec une gĂŠnĂŠralisation du FTTH ou du câble. Avec 20 millions de foyers en simultanĂŠ et en unicast, cela donnerait un besoin de 480 TBits/s. Mais ceci est le âworst-case scenarioâ car mĂŞme avec une gĂŠnĂŠralisation de la consommation de TV en mode linĂŠaire, on peut estimer que la consommation de TV linĂŠraire restera majoritaire. Tablons sur 60% des foyers avec une consommation linĂŠaire. La taille du tuyau nĂŠcessaire pour relier lâIrlande Ă la France est alors divisĂŠe par deux. Mais il faudrait remultiplier par deux le dĂŠbit pour tenir compte du multiĂŠcrans dans les foyers avec lâhypothèse de deux ĂŠcrans connectĂŠs par foyer en simultanĂŠ en moyenne.

Jâai pris lâIrlande comme exemple car les amĂŠricains sây installent souvent pour des raisons pratiques et fiscales. A moins que la France change beaucoup de choses, il y a peu de chances que Google ou Apple y installent leurs data-centers.

A terme dâune dizaine dâannĂŠe, ces diffĂŠrents dĂŠbits (132 Ă 480 TBits) semblent envisageables dâun point de vue technologique du cĂ´tĂŠ des âautoroutesâ de fibres optiques entre pays. Ces dĂŠbits alourdiraient certainement tout autant les ânationalesâ des opĂŠrateurs du pays. Mais cela donne une idĂŠe du domaine du possible. Une bonne manière de faire de la prospective consiste toujours Ă ĂŠvaluer lâimpact potentiel de la loi de Moore et de ses dĂŠrivĂŠs sur les infrastructures de tĂŠlĂŠcommunications. Une autre loi est immuable : si le dĂŠbit augmente, il sera utilisĂŠ tout comme un disque dur se remplit toujours, quelle que soit sa capacitĂŠ !

Ceci rĂŠpond Ă une question clĂŠ plus quâintĂŠressante : Ă terme dâune douzaine dâannĂŠe, les flux IP pourront potentiellement remplacer les flux broadcast traditionnels (satellite, TNT) pour une grande partie des usages. A modèle ĂŠconomique iso, les opĂŠrateurs amĂŠricains horizontaux (Google, Apple mais aussi Amazon ou Netflix) pourraient nous alimenter en contenus vidĂŠo linĂŠaires et non linĂŠaires jusquâĂ la 4K. Ce, dâautant plus, que le très haut dĂŠbit (FTTH ou câble) sera en principe gĂŠnĂŠralisĂŠ dans les foyers français Ă cet horizon.

Mais tout cela est ĂŠvidemment très thĂŠorique. Cela fait fi dâun tas de facteurs : la montĂŠe en puissance rĂŠelle des infrastructures, lâintĂŠrĂŞt des acteurs ĂŠconomiques Ă les mettre en place, lâimpact sur le coĂťt des services et des contenus pour les usagers, lâĂŠvolution de la règlementation et tout le toutim. Cela nĂŠglige aussi les autres usages que la TV HD ou UHD, mais cet usage est un bon ĂŠtalon car câest celui qui reste le plus consommateur de bande passante.

Sur ce, cette mise en bouche est terminĂŠe. Dans l’article suivant, je me penche un peu plus en dĂŠtails sur les travaux de recherche dâAlcatel-Lucent de Marcoussis et Villarceaux sur les technologies que nous venons de couvrir rapidement.

![]()

![]()

![]()

Reçevez par email les alertes de parution de nouveaux articles :

![]()

![]()

![]()

Articles

Articles

L’analogie routière pour dĂŠcrire les rĂŠseaux de communication : http://t.co/0O8WxedFvI

@michellondon tu as un nouveau fan ! “Comment Alcatel-Lucent augmente les dĂŠbits dâInternet –Â 1” de @olivez sur http://t.co/2K58YZZX0W

Merci pour cette tres eclairante vulgarisation a propos des reseaux internet ! Vivement la suite de l’article.

Bonjour,

Peut ĂŞtre un petit oubli de lien, cf “(vidĂŠo)”.

Concernant “Lâimpact sur la tĂŠlĂŠÂviÂsion numĂŠrique via Internet”, dans le calcul prĂŠdictif de la bande passante nĂŠcessaire, je pense que l’on peut ĂŠgalement ajouter un facteur de 0.8 (ou moins) car Ă un instant t, tout le monde ne consommera pas un contenu linĂŠaire (mĂŞme aux heures de pointes , tout le monde ne regarde pas le TV). De plus, une consomÂmation linĂŠaire n’interdit pas l’utilisation des CDN. D’oĂš un dĂŠbit revoir encore Ă la baise.

Et ce calcul suppose donc que Google TV et Apple TV doivent ĂŞtre capable de diffuser ces centaines de TBits de flux linĂŠaire, et lĂ j’ai quand mĂŞme des doutes.

PS: merci pour vos articles toujours d’un bon niveau et qui traduise bien la curiositĂŠ dont nous sommes friand.

Bonjour Laurent,

Merci d’avoir relevĂŠ l’oublie du lien sur la vidĂŠo, qui est maintenant ajoutĂŠ.

Concernant mon calcul, c’ĂŠtait une sorte de “worst-case scenario” qui prĂŠsente l’intĂŠrĂŞt, une fois que l’on applique toutes les optimisations imaginables (CDN et autres), de montrer que le broadcast Ă très grande ĂŠchelle de la TV numĂŠrique sur IP et via la fibre est envisageable, y compris pour de la vidĂŠo de très haute qualitĂŠ (Full HD puis UHD/4K).

CĂ´tĂŠ data-center, le dĂŠfi serait significatif, mais est-ce le plus difficile Ă rĂŠaliser ? LĂ -encore, c’est surtout une question de coĂťt et d’ĂŠquilibre ĂŠconomique. Aujourd’hui, la diffusion de la TV linĂŠaire par TNT ou satellite revient bien moins cher que par IP. Cela restera le cas encore quelques annĂŠes !

Beaucoup de pĂŠdagogie pour expliquer les infra numĂŠriques par @olivez sur http://t.co/8dmuRDla9a

“Comment Alcatel-Lucent augmente les dĂŠbits dâInternet –Â 1” de @olivez sur http://t.co/8dmuRDla9a

@fadouce En 2012, des Japonais avaient dÊjà atteint 84,5 Tbits/s sur une seule fibre. La nouveautÊ ici est le compo⌠https://t.co/3o5YJDhLbc