Parmi les nombreuses prouesses de l’intelligence artificielle qui sont régulièrement montées en épingle, celles qui touchent à la création ou à la modification de contenus sont les plus intrigantes. La magie du deep learning produit des images, des vidéos, de la musique et même des textes inédits. Les traditionnels élans anthropomorphiques associent des qualités créatives à des logiciels qui appliquent machinalement des algorithmes et sont eux-mêmes le résultat de longues itérations de chercheurs et développeurs. On en vient bien rapidement à confondre l’intelligence des individus qui créent et exploitent ces outils d’un nouveau genre et celle des outils qui la mettent en valeur. C’est l’objet de ce papier que d’examiner ces avancées récentes de l’IA et d’en évaluer le potentiel créatif.

Comme pour la notion même d’intelligence artificielle, celle de créativité pourrait donner lieu à quelques exercices sémantiques sans fin. Qu’est-ce donc que la créativité ? Je ne suis pas en mesure d’étaler une érudition philosophique que je n’ai pas. Nous nous contenterons de faire appel à Wikipedia pour rappeler que la créativité est la capacité d’un individu ou d’un groupe à imaginer ou construire et mettre en œuvre un concept neuf, un objet nouveau ou à découvrir une solution originale à un problème. Bref, la créativité consiste surtout à sortir des clous !

Cette définition reprend celle de la chercheuse anglaise Margaret Boden qui est une référence en la matière avec son ouvrage Creative Minds Myths and Mechanisms (1990 et 2004). Elle insiste sur le côté multi-facettes et multi-domaines de la créativité humaine dont toute personne est douée d’une manière ou d’une autre. Et aussi sur la différence entre la nouveauté pour le créateur et dans sa dimension historique globale. Quelqu’un qui réinvente quelque chose d’existant dont il n’a pas connaissance est tout de même créatif !

La créativité “computationnelle” a même sa conférence annuelle, l’International Conference on Computational Creativity (ICCC), dont vous pouvez consulter les volumineux actes de l’édition 2017 qui s’est tenue en juin à Atlanta ainsi que ceux de l’édition 2016 qui avait lieu à Paris. C’est assez ardu et comme dans tous les champs de l’intelligence artificielle, le croisement de celui-ci et de la créativité y sont abordés en toutes petites pièces détachées.

Avec cet éclairage en tête, nous allons faire un tour d’horizon pratique des performances créatives de l’IA récemment mises en avant puis les décortiquer pour comprendre ce qui les sépare ou non de ces notions humaines de créativité. En général, ces performances s’appuient sur des réseaux neuronaux génératifs aussi bien convolutionnels (CNN, Convnets) que récurrents (RNN, LSTM) qui sont capables d’extrapoler des contenus à partir de contenus existants, ou qui combinent divers contenus existants pour en créer de nouveaux.

Création graphique

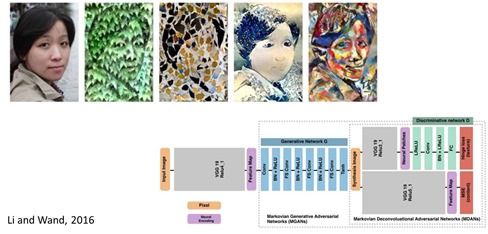

Les réseaux de neurones génératifs font des progrès réguliers dans leur capacité à associer plusieurs contenus. Typiquement, comme dans le cas suivant, une photo peut-être associée à une texture particulière comme des feuilles, et elle sera “peinte” avec cette texture. Le résultat est innovant et créatif ? Oui, comme toute forme de patchwork graphique. On voit dans les exemples comme le dernier que certains fonctionnent mieux que d’autres. C’est le choix du créatif que de le mettre en avant après avoir testé plusieurs textures.

Le procédé est extensible à l’application, non pas d’une simple texture, mais d’un style de peinture complet, reprenant le principe du pastiche. L’approche est toujours saisissante lorsque les exemples sont bien choisis comme ci-dessous, avec du Picasso ou du Gauguin (PS: sorry… plutôt du van Gogh). N’oublions pas un biais des chercheurs qui tentent diverses approches et présentent celles qui fonctionnent en éliminant les combinaisons qui n’ont pas été satisfaisantes. Est-ce que ce genre de création sort des clous ? Pas tant que cela. Picasso sortait des clous, pas l’IA qui transpose son style dans un personnage de dessin animé !

Voici un autre exemple, issu de A Neural Algorithm of Artistic Style de Leon Gatys, Alexander Ecker et Matthias Bethge (2015). Des techniques aussi sophistiquées que le fameux sfumato de Léonard de Vinci semblent reproductibles avec cette méthode. On peut aussi se débarrasser du sfumato dans le processus (vidéo) !

Dans chacune de ces réalisations, les contenus d’origine proviennent d’artistes humains ou de photos. L’IA est donc un bon outil pour combiner diverses sources d’existant. Le contenu résultant est-il pour autant véritablement original ? Génère-t-il un nouveau style de peinture ? Pas vraiment puisqu’il applique un style existant. On pourrait sans doute combiner plusieurs styles pour en créer un qui soit réellement nouveau. C’est ce que permet en théorie Pikazo, une application iOS qui sert à combiner de manière créative plusieurs photos et peintures.

Le deep learning est aussi utilisé dans la création graphique ou la création de sites web. C’est ce que réalise le site de création de sites web Wix (vidéo). Il s’est entrainé en analysant le style de nombreux sites web et leur performance (SEO, trafic) pour en déduire empiriquement les paramètres d’un bon site, le tout, en fonction de plusieurs milliers de professions (source). L’outil de création de sites web va également exploiter l’ensemble des textes et visuels disponibles sur la société pour bâtir une maquette de site. La création du site est guidée par l’utilisateur qui va tout de même choisir de attributs de sa marque pour influencer le design généré et ses couleurs dominantes. Le danger de ces outils ? Ce n’est pas une surprise : il risque de faire converger les sites créés vers un design voisin.

Une approche voisine est proposée pour l’instant de manière expérimentale par Adobe (source). Le tout s’intègre dans l’Adome Experience Manager CMS (outil de création de site) et exploite Adobe Sensei, la plateforme logicielle qui intègre les briques d’AI de l’éditeur. Cette IA est focalisée sur l’ajustement des contenus graphiques, pour mieux cadrer les illustrations.

Enfin, citons LogoJoy, un service en ligne de création de logos. La méthode est un peu bourrine : l’utilisateur sélectionne d’abord cinq styles qui lui conviennent, indique le nom de sa société puis son slogan et enfin, choisi une couleur et cinq icones qui correspondent à son service. A partir de là, le système génère un logo (démo). Ce n’est pas très créatif puisque le logo associe le nom de la société, son slogan et tout ou partie des icônes sélectionnées. C’est encore une technique de mash-up. Mais, si cela se trouve, le résultat est aussi bon qu’avec une bonne part des créateurs traditionnels de logos.

Ces différentes solutions ont un point commun : elles s’appuient sur des réseaux de neurones qui sont entrainés avec des volumes d’images plutôt raisonnables vis à vis des réseaux de neurones de reconnaissance d’images. Il n’est pas nécessaire d’ingérer 100 millions d’images pour créer des pastiches de peintures. Quelques milliers suffisent d’après ce que l’on peut lire dans les articles de recherche associés !

Création musicale

La musique est le second sujet de prédilection de la créativité par l’IA après les arts graphiques. Cela fait au moins trois décennies que diverses expériences ont été menées pour composer automatiquement de la musique en tirant parti de l’apprentissage basé sur des bibliothèques de musiques existantes.

L’offre logicielle actuelle est plutôt abondante dans la création musicale à base d’IA. Elle est souvent issue de laboratoires de recherche, comme l’IRCAM français, mais certaines offres commerciales sont disponibles, également avec une importance contribution française.

Citons par exemple :

- Orb Composer du Toulousain Hexachords qui génère de la musique orchestrale. Voici un exemple d’accompagnement musical d’un documentaire, un exemple convenable, ce genre de musique étant surtout une musique de fond. Ce n’est évidemment pas du niveau de la Bataille de Carthage de Gladiator par Hans Zimmer !

- OMax est un logiciel open source provenant de l’IRCAM qui accompagne en temps réel un musicien en live. Comme dans le cas présent, l’IA a un repère à suivre.

- Issu de l’UMPC (Université Pierre et Marie Curie), le projet Flow Machines combine des styles musicaux à des mélodies, une sorte d’équivalent des pastiches vus en peinture. Voici un exemple inspiré des Beatles. Là encore, on s’appuie sur de l’existant.

- Le français AIVA génère de la musique classique et symphonique en exploitant 15 000 partitions de compositeurs classiques et du deep learning à base de renforcement et de création aléatoire (stochastique). Cf à leur sujet Will the Next Mozart be a Robot? de Dom Galeon (novembre 2017).

- L’Anglais Jukedeck compose automatiquement de la musique d’accompagnement de vidéos. C’était un finaliste du concours de startups de LeWeb en décembre 2014. C’est aussi ce que propose l’Américain Amper Music qui fournit même son service sous forme d’API en cloud.

- Le logiciel open source allemand Ludwig sert à créer de l’accompagnement musical d’une mélodie fournie par l’utilisateur (exemple).

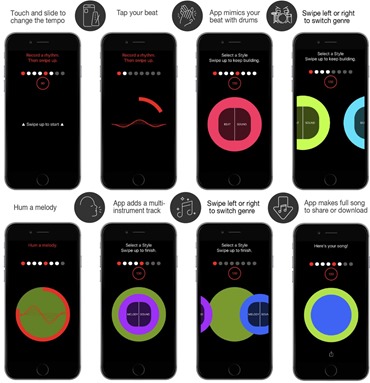

- Dans le même genre, l’Américain Humtap (vidéo) génère automatiquement un accompagnement musical en exploitant une simple mélodie que vous chantez à votre mobile ou votre PC. C’est plutôt bluffant et très efficace ! Et vous êtes la première source d’inspiration.

- L’Américain Popgun.ai (2017) utilise le deep learning pour apprendre les bonnes règles musicales à partir de compositions humaines pour enrichir des compositions existantes. La démonstration de leur prototype Alice est sympathique (vidéo) mais pas forcément facile à mettre en pratique.

- Amper Music (2014, $4M) est un site en ligne, pour l’instant gratuit, qui compose automatiquement de la musique via de l’IA (vidéo). Il faut tout de même le paramétrer pour indiquer ses souhaits en termes d’instruments, de tempo, de style et de durée. C’est pratique pour créer des compositions qui vont alimenter les vidéos de démonstration de startups, et éviter les habituelles musiques d’ukulélé qui les accompagnent régulièrement. Le service a publié son premier album complet en aout 2017.

- Google est aussi de la partie avec son projet de recherche Magenta qui aide les musiciens à être créatifs en combinant toutes les formes de deep learning imaginables (vidéo). Cf How Google is making music with artificial intelligence de Matthew Hutson (aout 2017).

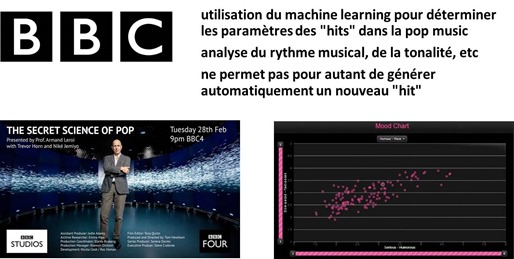

Toutes ces initiatives sont à la recherche du même Graal : la génération de musique qui tape à l’oreille et aux émotions, qui se retient, qui devient éventuellement un “hit”. Mais elles n’y parviennent pas encore. Le chercheur de la BBC Armand Leroi avait essayé de découvrir l’ADN des hits de la musique pop. A force de machine learning et d’analyse de plusieurs décennies de pop music, il avait identifié des évolutions temporelles dans les tendances dans le rythme et l’accompagnement, mais sans parvenir à découvrir la sauce magique des hits (cf The secret science of pop de Armand Leroi, qui date de début 2017).

Toutes ces solutions logicielles ont en commun le fait qu’il s’agit d’outils. Le discernement musical reste une affaire humaine. Ne serait-ce que pour que les compositions et leur interprétation véhiculent un maximum d’émotions. Or on ressent l’absence d’émotion en écoutant la majorité des créations musicales issues de l’IA qui sont générées automatiquement. Seules celles qui ont été sélectionnées et retravaillées par des oreilles averties ont une chance de nous toucher. Pour l’instant.

Création vidéo

La création de vidéo à base d’IA est moins courante et beaucoup moins impressionnante que la musique à créée par de l’IA. L’un des exemples les plus connus est celui de la startup israélienne Wibbitz (2011, $30,8M) avec sa solution qui génère automatiquement des vidéos d’actualité à partir de contenus textuels et de scrapping de contenus vidéos. La dose d’IA de cette solution n’est cependant pas bien documentée.

Plus récemment, Intel a contribué à la création d’un clip vidéo pour une chanteuse chinoise, Chris Lee. D’un point de vue pratique, la contribution de l’IA est liée à la construction en 3D du visage du chanteur et à l’ajout d’effets spéciaux dessus comme des gouttes d’eau ruisselantes. La créativité dans cette affaire reste dans les mains des équipes qui ont créé ce clip (détails vus sur Ubergizmo).

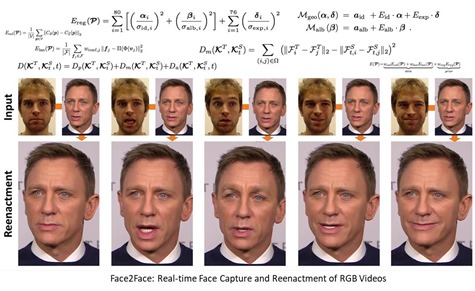

Ce système rappelle d’ailleurs le projet de recherche face2face des Allemands et Américains Justus Thies, Michael Zollhofer, Marc Stamminger, Christian Theobalt et Matthias Nießner (vidéo, papier) datant de 2015. Il permet de transposer les mimiques d’une personne filmée avec une simple caméra 2D sur un autre visage, Daniel Craig ou Barack Obama dans les démonstrations de ce projet de recherche. Comme on sait aussi générer des voix synthétiques à partir de l’échantillonnage d’une voix connue, par exemple chez Lyrebird, nous ne sommes pas loin de la possibilité de créer avec de l’IA de véritables “fake videos” de personnes connues ou inconnues.

Création textuelle

Le deep learning est aussi capable de générer des textes. La plupart du temps, la créativité est loin d’être au rendez-vous. C’est le cas pour ces outils de génération de dépêches d’agences de presse qui mettent en forme des informations quantitatives issues, par exemple, de résultats financiers d’entreprises ou de compétitions sportives. Les systèmes se sophistiquent un tant soi peu lorsqu’ils exploitent aussi les données historiques associées. Les outils de ce genre sont légion et sont notamment proposés par Automated Insights, Textomatic, Narrative Science, LabSense, Syllabs, Retresco et Yseop.

La créativité semble pointer du nez dans des expériences de génération de fictions. C’est le cas avec ce récent projet du MIT Media Lab qui a permis de générer des histoires d’horreur basées sur l’analyse de 140 000 histoires. Un nombre qui rappelle les 150 000 parties de jeu de Go qui avaient servi à entrainer les premières versions d’AlphaGo qui s’en est ensuite passé dans sa dernière mouture. J’explique dans Les conséquences pratiques d’AlphaGo Zero (novembre 2017) pourquoi cela ne s’applique qu’aux problèmes à règles discrètes simples. Dans la pratique, ce système de génération de texte est assisté par des auteurs.

Un certain Max Deutsch s’est attaqué à un des besoins les plus fondamentaux de la jeunesse mondiale en créant de nouveaux chapitres des livres de Harry Potter à base de réseaux de neurones. Les données d’entrainement ? Et bien, tous les Harry Potter, pardi ! Le résultat ? Au moins, les phrases sont bien plus correctes que n’importe quel tweet de Donald Trump, avec moins de prises de tête du type covfefe pour en comprendre le contenu ! Max Deutsch s’est aussi amusé à rédiger avec la même méthode des scènes de Star Wars. Ces films ne sont cependant pas très créatifs, reprenant des trames assez classiques, notamment bien documentées dans le très ancien “The hero with 1001 faces” de Joseph Campbell (1949).

L’IA peut aussi servir à améliorer des textes exitants. WordAi est une startup qui fournit un outil de réécriture de vos textes pour les rendre lisibles par de vrais gens ! Le travail réalisé relève de la reformulation d’expressions existantes. D’autres produisent des résumés automatiques de textes en extrayant les expressions les plus pertinentes d’un document. Je n’ai cependant pas encore mis la main sur un outil qui démarketinginserait un texte trop marketing.

Tout ces outils ne sont pas encore très créatifs et restent cantonnés à la production de textes courts. C’est ce qu’explique Walter Frick dans Why can’t AI write this article (yet) (HBR, juillet 2017). Même s’il évoque la création d’un scénario par une IA (vidéo associée).

La prochaine étape créative résiste dans la capacité des outils de l’IA à faire preuve d’humour. Celui-ci est décryptable au niveau de ses composantes élémentaires, comme dans la création d’analogies. Cela a démarré avec des IA capables de déterminer la présence d’humour dans des textes. Une vingtaine de travaux de recherche sur l’humour de l’IA ont été publiés dès 2012 (AAAI) et leur bibliographie remonte aux années 1990 !

La capacité à reconnaitre l’humour et à en faire preuve est un domaine de recherche pas si futile que cela. Il est exploré pour alimenter les robots doués de capacités de conversation et d’empathie. Cf It’s hard work being funny—especially for robots de Daniela Hernandez (2016).

Le robot Sophia de Hanson Robotics (ci-dessus) qui a obtenu la citoyenneté en Arabie Saoudite en octobre 2017 constituait une grosse foutaise symbolique. Il fait preuve de zéro humour et empathie ! Ce d’autant plus qu’il n’était même pas évident qu’il ait pu faire autre chose que débiter des “talking points” préparés à l’avance dans les conférences où il intervenait. Il générait cette impression au Web Summit de Lisbonne début novembre 2017 (repris ci-dessous dans Les Echos). Au passage, personne n’a remarqué que ce robot n’était qu’un buste incapable de se mouvoir dans l’espace. Le projet Sophia est mené par Ben Goertzel, un spécialiste de l’IA très investi depuis plus d’une décennie dans le développement d’AGI (intelligence artificielle générale).

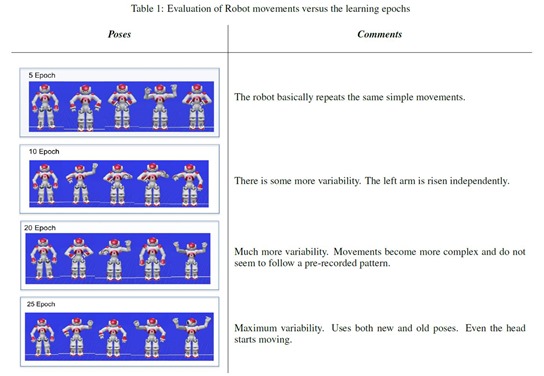

Les robots donnent aussi lieu à des tentatives de les rendre créatifs dans leur capacité à se mouvoir et notamment à danser. C’est le travail du projet “Creative Robot Dance with Variational Encoder” d’une équipe de chercheurs italiens présenté lors de l’ICCC 2017, avec des exemples réalisés à l’aide du robot Nao de Softbank Robotics (vidéo d’exemples).

Création d’objets

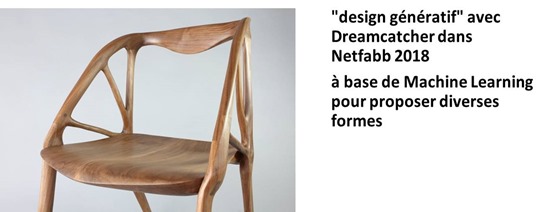

Les réseaux de neurones génératifs sont aussi capables de créer des objets artificiels en mélangeant plusieurs styles à façon. C’est une variante des outils de création graphique vus au début de cet article. L’éditeur de logiciels de CAO Autodesk s’est lancé là-dedans avec une évolution de sa solution Dreamcatcher annoncée en 2017 et prévue pour 2018.

Créativité scientifique

Le prochain Graal de la créativité de l’IA sera de l’appliquer à la recherche scientifique. A ce stade, c’est encor un sujet en devenir. Les chercheurs peuvent évidemment s’appuyer sur des applications de machine learning et de deep learning pour orienter leurs travaux.

Nous en avons un exemple classique en biologie moléculaire. Le machine learning permet d’identifier la corrélation entre mutation génétiques et apparition de cancers divers. Cela permet de faire de la médecine prédictive et d’anticiper l’émergence de pathologies. Reste à les traiter ! Et il faut rentrer dans le lard de la biologie pour trouver comment s’attaquer aux cellules malignes, à leur membrane ou à leur génome. Tout le travail reste à faire et il est très lourd.

Les limites des systèmes d’IA actuels bâtis sur le machine learning et le deep learning proviennent de ce qu’ils ne gèrent pas de logique formelle et d’IA symbolique. C’est un domaine où heureusement de nombreux chercheurs sont actifs. Un jour viendra peut-être où le raisonnement automatisé permettra de découvrir quels chemins de recherche privilégier par la logique et en s’appuyant aussi sur les données disponibles.

Créativité dans la résolution de problèmes

Dernier sujet, la créativité dans la résolution de problèmes complexes auxquels sont notamment confrontés les entreprises. Comment innover ? Quels nouveaux produits créer et commercialiser ? Comment optimiser son mix marketing ? Quelle politique économique mener dans un pays ? Comment négocier avec une autre entreprise ou un autre pays dans les affaires ou la politique ? Comment attirer les talents dans son entreprise ?

A ce jour, les solutions à base d’IA pour résoudre ce genre de problème sont périphériques. Ce sont le plus souvent des outils qui fournissent ou mettent en forme des donnée qui aident à circonscrire ces problèmes ou à simuler des scénarios. La combinaison des idées en environnement d’information incomplet est généralement l’affaire des idées humaines et autres groupes de travail.

Les processus créatifs peuvent s’appuyer sur des données et de l’IA pour réaliser des simulations et valider des hypothèses. Mais alimentés par les données du passé, ces outils peuvent-ils vraiment anticiper le futur ? De tels outils auraient-ils été d’une quelconque aide à Steve Jobs et les équipes d’Apple lorsqu’elles ont créé l’iPod, l’iPhone ou l’iPad ? Et une IA pourrait-elle inventer la danse moonwalk de Michael Jackson, via un processus identique ou différent de celui qui a mené ce dernier à la créer ?

So ?

Nous avons exploré d’un point de vue pratique les performances de quelques solutions d’IA dans divers domaines comme la création graphique, musicale ou textuelle.

A chaque fois, sont mises en jeu des bribes de créativité et d’aide à la créativité. Ces outils fonctionnent avec une assistance humaine et sont rarement entièrement autonomes. L’IA n’est pas créative en tant que telle. Elle fournit des outils qui assistent l’Homme dans sa créativité. La créativité humaine est encore le résultat de la réutilisation et de la combinaison de l’existant à partir d’une palette qui s’élargit sans cesse. Mais elle intègre des éléments de contexte, d’audience et aussi, la capacité à véhiculer des émotions et de s’adapter à des audiences.

C’est l’Homme qui fait preuve de discernement et qui fait le tri de ce que les outils de l’IA peuvent produire. Les exemples publiés par les chercheurs sont d’ailleurs très souvent triés sur le volet, générant une sortie de biais positif de perception de leur créativité. Les choix restent humains. C’est la thèse défendue par Magaret Boden dans Artificial Creativity, Why computers aren’t close to being ready to supplant human artists en 2015, qu’elle détaille également dans Creativity and Artificial Intelligence: a contradiction in terms?.

Ce que l’on appelle “l’IA” est généralement issue de la “collaboration” entre humains et de l’IA. On joue sur les mots par sensationnalisme au lieu d’évoquer l’exploitation d’outils. C’est une anthropomorphisation sémantique de l’outil comme si on disait que le marteau du sculpteur ou la peinture du peintre étaient “créatifs”. Ceci ressort bien de la belle série d’articles excellemment documentés produits en juin 2017 par l’Allemand Thomas Euler : “Will the Next Pop Cultural Icon Be an AI? A Guide Through Computational Creativity” (partie 1, partie 2, partie 3, partie 4). Il y traite de la créativité dans la musique, l’écriture, les arts graphiques, la publicité, la vidéo et les jeux vidéo. J’en ai tiré bon nombre des exemples d’IA citées ici même et qui montrent à chaque fois que l’IA est un outil et rarement plus que cela.

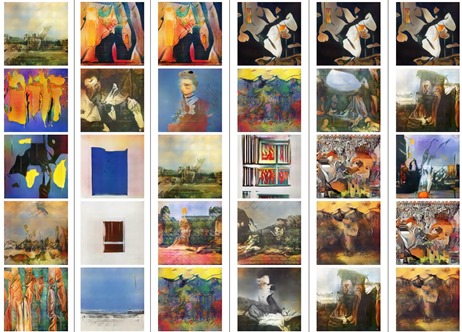

La créativité requiert une capacité et une volonté à sortir des clous et des contraintes existantes. Les grands créatifs ne suivent pas la moyenne. Ils font avancer l’état de l’art. Ils ont un côté rebelle et incompris, au moins à leurs débuts. Or les outils de l’IA fonctionnent par entrainement avec des données existantes. Ils font converger la créativité vers la moyenne et l’existant et permettent rarement de s’en éloigner. Cette moyenne n’est pas naturellement atypique. Une voiture générée par une IA alimentée par les voitures existantes et des sondages ressemblerait à une berline des plus classique et lisse. C’est une limitation sur laquelle planche l’équipe américaine du projet “CAN: Creative Adversarial Networks – Generating “Art” by Learning About Styles and Deviating from Style Norms” (vue dans les actes de l’ICCC 2017). Ils veulent faire apprendre des styles à une IA puis à l’aider à sortir de leur cadre (exemples ci-dessous). Le tout fait encore appel aux fameux réseaux de neurones génératifs de type GAN (Generative Adversarial Networks).

On peut aussi jouer au jeu du réductionnisme de la créativité et la décortiquer en composantes isolées. Mais souvent, on le fait a posteriori, comme en remontant aux sources d’inspiration de Steve Jobs dans sa passion pour le design et la simplicité. La créativité vient aussi de la connaissance physique du monde que les solutions de l’IA ressentent mal, dans le meilleur des cas avec des images 2D en 224×224 pixels, la résolution couramment utilisée par les réseaux de neurones convolutionnels de reconnaissance d’images.

Il ne faut évidemment jamais dire jamais. Une bonne part des créations humaines sont triviales et faiblement innovantes au regard de l’existant. Et la détection et l’analyse des émotions humaines est à la portée des objets connectés et de l’IA. Ce sont des domaines où l’IA fera certainement des progrès significatifs dans les années à venir. L’IA créative et rebelle ferait son apparition en devenant “générale”, voir même avant, sur des sujets ad-hoc. A ceci près que ce stade est considéré comme étant dangereux par ses effets de bord incontrôlables. Nous avons donc intérêt à nous contenter d’IA faiblement créative jouant simplement le rôle d’outils de travail pour les créatifs de tout poil.

Une bonne part des prouesses créatives de l’IA d’aujourd’hui provient des laboratoires de recherche. Comme pour toutes ces révolutions technologiques des décennies passées, l’IA créative prend déjà rapidement la forme de solutions et briques fonctionnelles prêtes à l’emploi avec des interfaces naturelles. Ce sont les startups, les Adobe, Autodesk et consorts qui les démocratisent. Il ne faudra pas être BAC+12 pour maitriser les nouveaux outils issus de l’IA ! L’IA fera cohabiter une rosace de compétences allant de la maitrise des couches basses les plus techniques jusqu’aux briques utilisateurs faciles d’emploi.

A court et moyen terme et avec le recul, je me rend compte que la question posée dans le titre n’est finalement pas la bonne. Elle serait plutôt de savoir à quelle vitesse et comment les créatifs vont s’emparer des capacités de l’IA pour être à la fois plus imaginatifs et plus productifs, deux notions que certains n’aimeront pas forcément mettre en regard. L’histoire du numérique a montré que la rapidité de ce processus variait selon les métiers. Les auteurs, maquettistes et graphistes se sont rapidement appropriés les logiciels de traitement de texte (Wordperfect, Word), ceux de mise en page (Pagemaker, Xpress), et de création graphique (Illustrator, Photoshop, Inkscape). Ont suivi les outils de création vidéo (Premiere, FinalCut, …). Les photographes professionnels ont été un peu plus longs à la détente lors du passage au numérique de leur métier au milieu des années 2000. C’était à la fois lié à leur conservatisme et aux progrès graduels des appareils photo reflex numérique par rapport à leurs équivalents argentiques.

Est-ce que l’IA va changer de manière radicale les méthodes d’apprentissage et les pratiques créatives de ces différents métiers ? Difficile à dire, sauf à adopter le catastrophisme ambiant du “tous foutus”. J’ai l’impression que ce changement ne sera pas bien plus radical que lors de l’apparition ces dernières décennies de nombre de nouveaux outils numériques (interface graphique, interface Web, mobile, réalité mixte). Il faudra juste vivre avec son temps et avec les outils de son temps !

_______________________________

Vous pouvez toujours profiter de l’ebook de 362 pages “Les usages de l’intelligence artificielle” publié sur ce blog en octobre 2017, qui fait un tour d’horizon très large des technologies de l’IA, du hardware de l’IA et de ses nombreux usages dans les marchés horizontaux et verticaux ainsi qu’un tour des stratégies des grandes acteurs et des méthodes de conduite de projets d’IA.

![]()

![]()

![]()

Reçevez par email les alertes de parution de nouveaux articles :

![]()

![]()

![]()

Articles

Articles

Merci Olivier pour ces articles toujours inspirants. A vous lire, je me suis demandé si le créatif “fort” (pour reprendre le qualificatif employé pour l’IA) n’est pas celui qui sait :

1)écrire un poème sur une page blanche ou peindre sur une toile blanche

2)expliquer l’intention et les émotions derrière sa création

A cette aune, les artistes (créativité “forte”) ont encore de beaux jours devant eux, et les “créatifs” seront heureux d’utiliser l’IA pour être plus productifs. Cela aura-t-il un impact sur leur nombre ? peut-être… mais pas de quoi nous amener à une redéfinition déchirante de ce qui est spécifique à l’humanité dans ce domaine (en tous cas, je n’en vois pas les germes pour l’instant).

Bonjour Yves,

Nous sommes … d’accord !

L’explicabilité de l’IA ne porte pas que sur les algorithmes mais aussi sur les émotions !

Olivier

Merci Olivier.

L’IA me fait penser à un énième miroir que l’Humanité se serait fabriqué, et qui somme toute ne fait que refléter une part de notre condition. Si la pierre puis le fer nous ont donné des millénaires d’admiration de notre silhouette, cette fois on se voit dans le fond des yeux et ça semble nous effrayer.

“L’#IA est-elle vraiment créative ?” Un excellent état de l’art de @olivez sur les tentatives de créer des IA créat… https://t.co/4fjFTqSo0J

#MustRead ✅L’IA est-elle vraiment créative ? by olivez

https://t.co/3WNUAJ77p1 RT @mallys_

#ia #créativité… https://t.co/qBHgEd7q8T

L’intelligence artificielle est-elle vraiment créative ? #IA #AI https://t.co/PoHzqNay64 Merci @olivez https://t.co/1cVkOjHc8G

#mustread L’Intelligence Artificielle est-elle vraiment créative ? https://t.co/Do8RsDZTgF

#IA #creativity #future… https://t.co/k377qquOyI